El 7 de noviembre de 2025, la división de investigación de Google (Google Research) publicó un artículo en su blog titulado “Introducing Nested Learning: A new ML paradigm for continual learning”. Google Research Este trabajo introduce el concepto de Nested Learning (Aprendizaje Anidado), una nueva forma de concebir los modelos de inteligencia artificial como un conjunto de procesos de optimización jerárquicos, con el objetivo de resolver desafíos clave como el llamado “olvido catastrófico”.

¿Qué problema aborda?

A pesar de los avances recientes en modelos de lenguaje y aprendizaje profundo, muchas arquitecturas todavía tienen dificultades para adquirir nuevos conocimientos sin perder los antiguos — una debilidad conocida como “catastrophic forgetting” (olvido catastrófico). Google Research Los autores del estudio señalan que los modelos tradicionales tratan la arquitectura y el algoritmo de optimización como sistemas separados, cuando en realidad pueden entenderse como niveles de aprendizaje interrelacionados.

¿En qué consiste el paradigma Nested Learning?

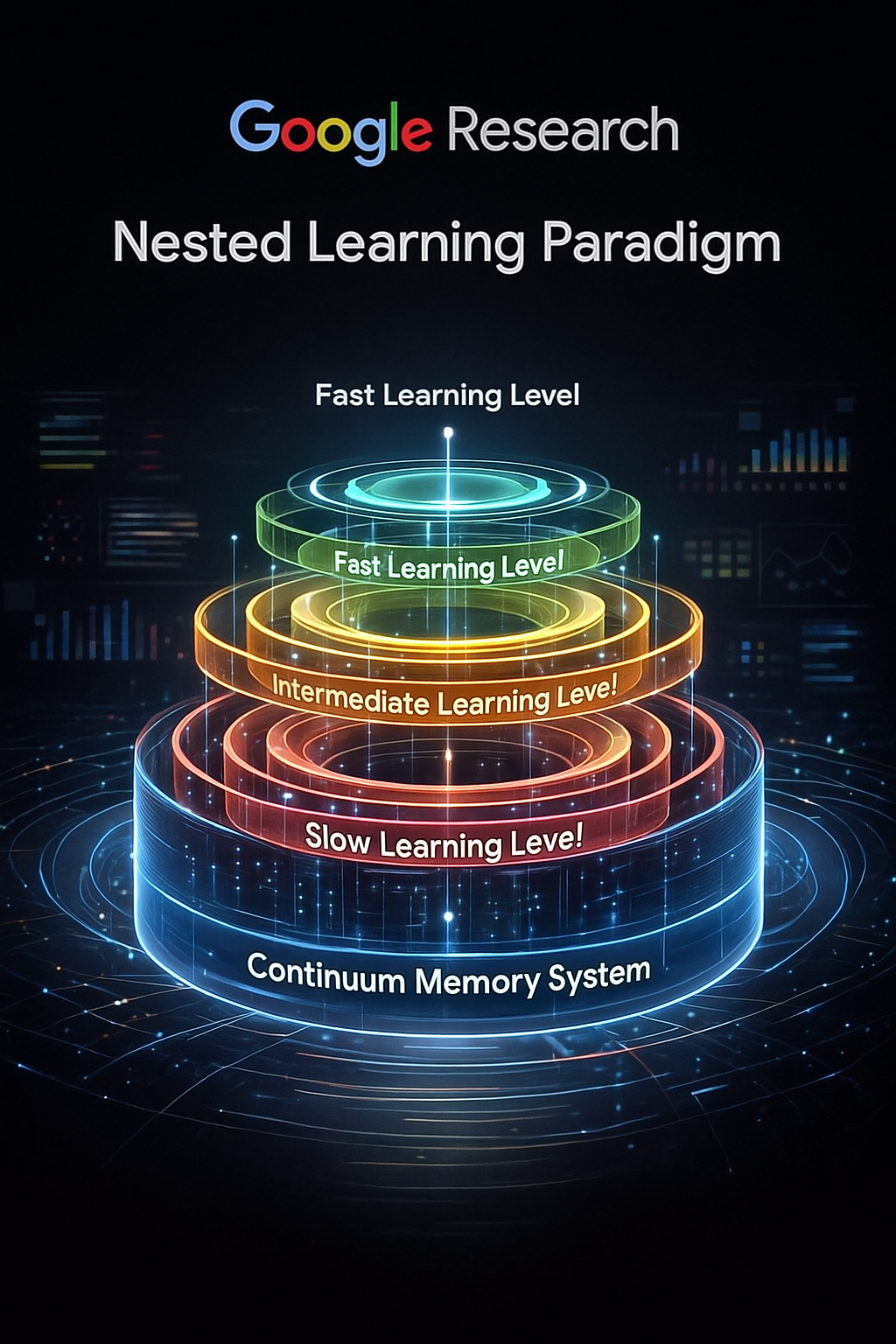

La propuesta es que un modelo de IA deje de verse como un único proceso de aprendizaje entrenado una vez, y pase a considerarse como una serie de sub-procesos de optimización anidados, cada uno con su propio flujo de contexto y frecuencia de actualización. Ali Behrouz

- Cada “nivel” del sistema procesa la información a un ritmo distinto: los más rápidos se adaptan a datos recientes, los más lentos consolidan conocimiento estructural de largo plazo. Medium

- En este marco, elementos como el propio optimizador (SGD, Adam) o mecanismos de memoria pueden interpretarse como módulos de tipo “memoria asociativa”. Google Research

- El paper de Google también presenta una arquitectura de prueba llamada HOPE que incorpora un sistema de memoria continuo (“Continuum Memory System–CMS”) y múltiples niveles de actualización para demostrar la viabilidad del enfoque. Google Research

Resultados clave y potencial

Los experimentos iniciales muestran que HOPE tiene mejor desempeño que arquitecturas estándar tipo Transformador en tareas de modelado de lenguaje, razonamiento sobre contexto extenso y memoria de largo plazo. Venturebeat. Esto abre la puerta a modelos de IA que pueden adaptarse, aprender de nuevas interacciones y retener ese aprendizaje sin requerir un nuevo entrenamiento completo.

Implicaciones para el futuro de la IA

Este paradigma puede tener varias implicaciones importantes:

- Puede permitir que los modelos de IA evolucionen “sobre la marcha” en entornos cambiantes sin borrar conocimientos previos.

- Introduce un enfoque más “neurocientífico” en la IA, inspirado en la plasticidad y memorización humanas.

- Sin embargo, también plantea desafíos: la infraestructura de hardware/software actual está optimizada para arquitecturas clásicas tipo Transformador, por lo que adoptar Nested Learning requerirá reconfiguraciones importantes. Venturebeat

Conclusión

Con Nested Learning, Google da un paso significativo hacia lo que podría considerarse una “inteligencia artificial verdaderamente continua”, que aprende, retiene y mejora sin necesidad de reinicio. Aunque estamos aún en una etapa de investigación, el impacto a medio-largo plazo para aplicaciones industriales, modelos personalizados y sistemas autónomos es muy relevante.

Deja una respuesta